Quan la IA aprèn sola: estem preparats per perdre el control?

Hi ha temes que tornen una i altra vegada a les converses sobre tecnologia. Fa un any parlàvem d’escala. Fa mig any, d’agents. I ara, de sobte, apareix un concepte que porta el debat a un terreny molt més delicat: l’auto-entrenament. Que un model es millori a si mateix.

La discussió ha esclatat després de la publicació aThe Guardian d’un article de Jared Kaplan, una de les ments que millor entén com hem arribat fins aquí. No és un titular fàcil i no crec que el to sigui alarmista, però quan diu que deixar que els models s’entrenin amb el seu propi output és “poderós, però profundament arriscat”, cal que hi fem una volta, perquè el problema no és si es pot fer, és que ja s’està fent. El dubte és si som prou madurs per gestionar-ho.

Quan la IA esdevé el seu propi mestre

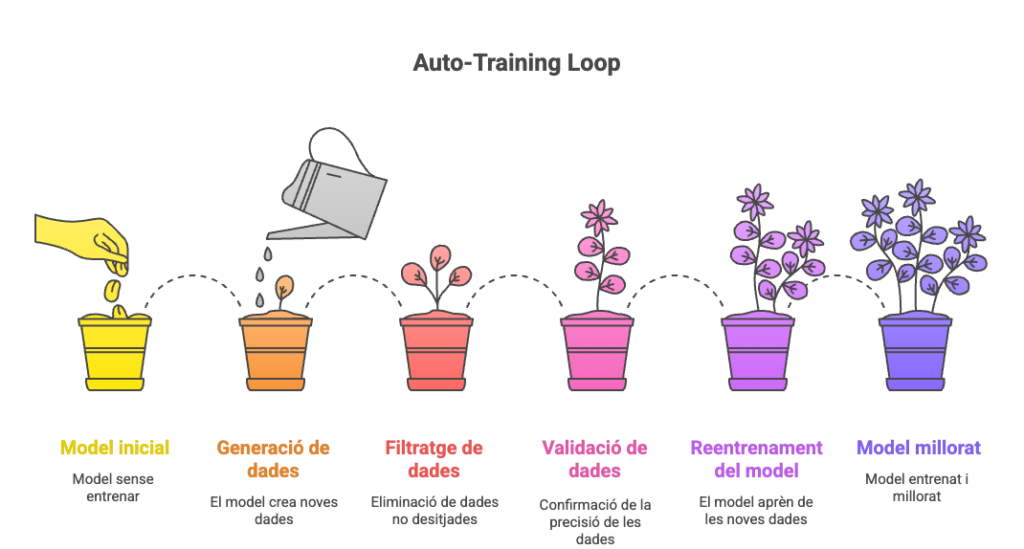

L’auto-training funciona així: el model genera noves dades, les filtra, les valida i després se les menja per tornar-se a entrenar. Un bucle tancat, un ecosistema propi, un cervell que s’autoalimenta.

En teoria, això és un cop d’eficiència espectacular. Menys dades etiquetades. Més iteracions. Millores constants sense haver de muntar operacions de dades gegants.

Per a startups i laboratoris, és tan seductor com tenir un empleat que treballa de nit, no cobra hores extres i mai es queixa.

El problema? Que també aprèn els seus propis errors.

El risc subtil: deixar de mirar prou a prop

Alguns investigadors ho diuen clar: si un model s’entrena amb la seva pròpia sortida, els seus biaixos no només es mantenen… Es multipliquen.

I aquí topem amb el veritable perill: la pèrdua progressiva de supervisió humana. Si l’output de cada versió es converteix en el punt de partida de la següent, com detectes quan el model ha pres un camí estrany? Quan s’ha desviat? Quan ha començat a “pensar” d’una manera que ningú havia previst?

No cal imaginar distopies. N’hi ha prou amb un model financer que comença a preferir decisions arriscades, un model sanitari que interpreta símptomes d’una manera lleugerament esbiaixada o un model jurídic que exagera certs patrons.

No és que la IA es torni boja. És que s’autoaïlla i començen els problemes.

La paraula prohibida: auto-millora accelerada

Hi ha un concepte que Kaplan menciona de passada: l’explosió cognitiva. No és una superintel·ligència malvada, Skynet, sinó un model que es millora més ràpid del que podem validar, és la versió moderna del “no pots controlar una reacció en cadena que accelera sola”.

Aquest risc és tan antic com els sistemes complexos: quan la velocitat d’evolució supera la capacitat de supervisió, el control deixa de ser real. I els humans sóm molt dolents gestionant velocitats que no entenem.

Els beneficis són reals. Els riscos també.

Fins ara, l’auto-training és una opció experimental amb un potencial enorme:

- Models més ràpids, més barats, més intel·ligents.

- Productes que milloren sols.

- Capacitat de competivitat per a empreses que no poden entrenar models gegants.

Però el preu pot ser alt:

- Qui és responsable d’un error d’un model auto-entrenat?

- Com verifiques les noves habilitats que apareixen en cicles que no controles?

- Com evites que un biaix petit esdevingui un patró gegant?

Si costa auditar un model avui, imagina auditar cent versions micro-evolucionades en un únic pipeline.

Order!!!! Necessitem regles

El punt de Kaplan no és frenar res. És posar normes abans que sigui tard. Perquè, si ens descuidem, el primer gran sistema auto-entrenat no sortirà d’un laboratori acadèmic: sortirà d’una startup que corre massa i llavors no parlarem d’hipòtesis, parlarem d’incidents.

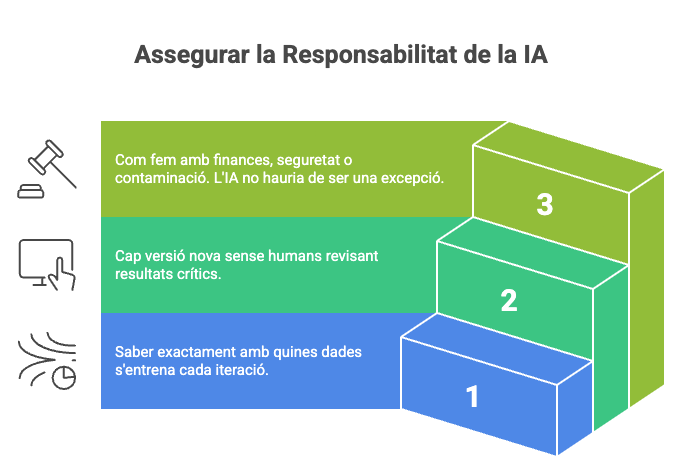

Així que les regles són clares:

1. Transparència del cicle d’auto-entrenament : Saber exactament amb quines dades s’entrena cada iteració.

2. Validació externa obligatòria : Cap versió nova sense humans revisant resultats crítics.

3. Auditories independents : Com fem amb finances, seguretat o contaminació. La IA no hauria de ser una excepció.

El futur immediat ens porta a un equilibri incòmode

La innovació no s’aturarà. L’auto-training és massa potent per desaparèixer. I, honestament, hi haurà qui el faci igualment, amb o sense regulació.

Però la pregunta que hem d’afrontar és simple i incòmoda:

Podem permetre que els models aprenguin sols sense entendre exactament què estan aprenent?

Jo avui diria que no, però potser d’aquí uns anys ja podrem dir que sí.

Però ara mateix, la nostra feina és evitar que les primeres generacions d’IA auto-entrenada quedin fora de control abans d’hora. El que no sé encara és si la regulació legal serà suficient… Però això ja és un altre tema.