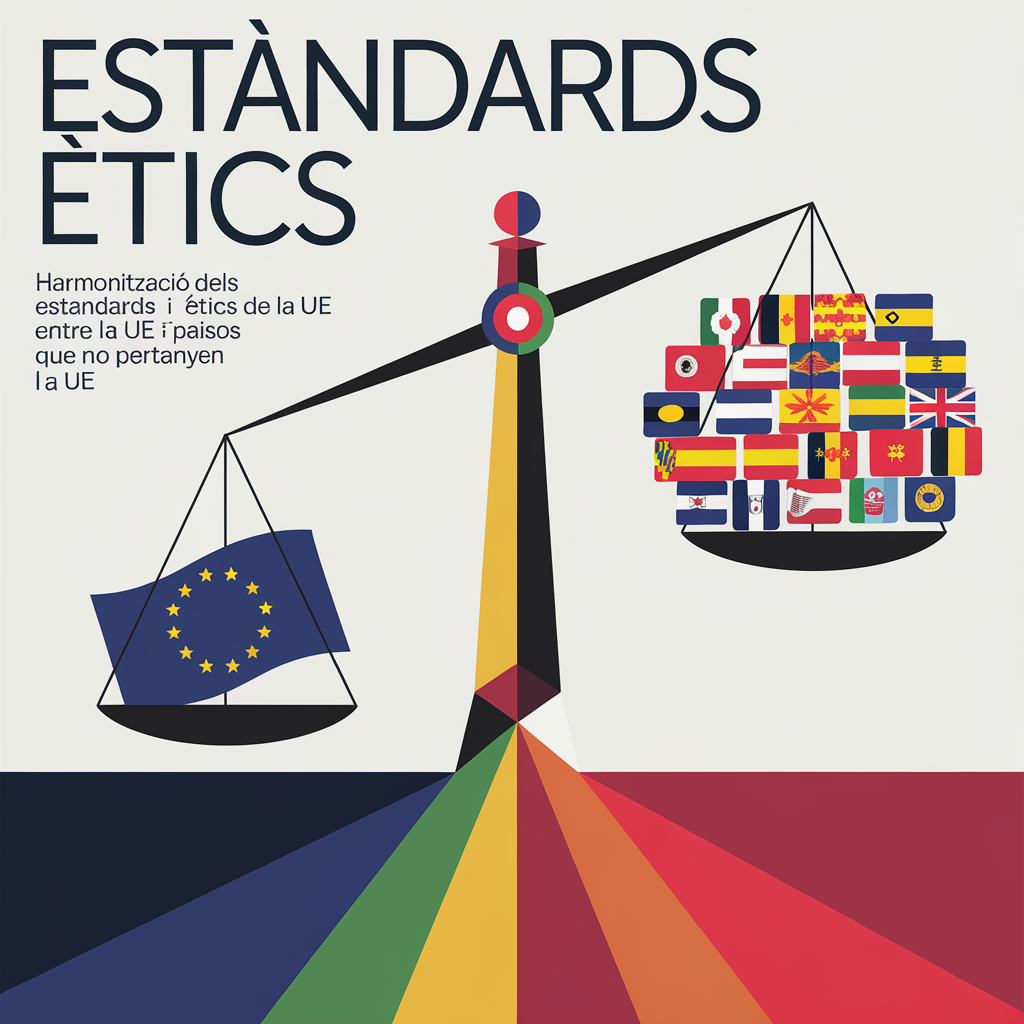

Harmonitzar els estàndards d’ètica de la IA a nivell global és cada cop més important. A mesura que la intel·ligència artificial continua evolucionant, el seu impacte en diversos sectors del món és cada cop més pronunciat. La Unió Europea (UE) ha pres un paper destacat en l’establiment de pautes ètiques, amb un marc que posa èmfasi en la confiança, la transparència i el respecte pels drets humans.

Però alinear aquests estàndards amb els dels països fora de la UE és crucial per crear un marc global cohesionat per a un desenvolupament responsable de la IA. Els reptes i oportunitats són diversos: les diferències en els marcs reguladors, les tensions geopolítiques i les perspectives culturals divergents sobre l’ètica poden complicar els esforços per harmonitzar els estàndards d’ètica de la IA. Tot i així, iniciatives com la Recomendació sobre l’Ètica de la IA de la UNESCO ofereixen possibles vies per superar aquestes bretxes.

Tot seguit fem un cop d’ull a la complexitat d’harmonitzar els estàndards d’ètica de la IA entre la UE i la resta del món, analitzant l’estat actual, identificant els reptes clau i destacant les oportunitats per crear un enfocament unificat per al desenvolupament responsable de la IA.

Situació actual dels estàndards d’etica de la IA

Llei de la IA de la UE: un enfocament basat en el risc

La UE ha assumit un paper destacat en la governança ètica de la IA amb la introducció de la Llei de la IA. Aquesta legislació adopta un enfocament basat en el risc, classificant els sistemes d’IA en diferents categories segons el risc que representin per als drets humans i la seguretat.

- Aplicacions d’alt risc: Estan subjectes a requisits estrictes, com ara mecanismes de supervisió, mandats de transparència i mesures de responsabilitat.

- Aplicacions de risc limitat: Han de complir obligacions bàsiques de transparència.

- Aplicacions de risc mínim: S’enfronten a una regulació mínima.

Aquest enfocament escalonat pretén fomentar la innovació mentre s’assegura que els sistemes d’IA d’alt risc respectin les pautes ètiques i s’intentan mantenir sota control.

Divergència en els marcs regulatoris

Però, quan es comparen les regulacions de la UE amb la resta de països, sorgeixen diferències notables. Per exemple, als Estats Units s’inclina cap a compromisos voluntaris en lloc de mandats estrictes i se centra en la innovació i la flexibilitat, permetent a les empreses autoregular-se. En unes altres paraules, les empreses són animades a desenvolupar les seves pròpies pautes ètiques sense enfrontar-se a regulacions rigoroses, mentre , com ja em vist, a la UE s’enforça el compliment obligatori amb requisits ètics detallats per a aplicacions d’alt risc. Naturalment. aquestes divergències creen reptes per a les empreses que operen internacionalment, ja que han de navegar per diferents marcs de compliment.

Principis clau: confiança i transparència

Tot i aixi, tenim similituds, la confiança i la transparència són principis essencials en l’ètica de la IA tant a la UE com als països fora de la UE.

- Confiança:

- Assegura que els sistemes d’IA siguin fiables, segurs i funcionin com s’espera.

- Genera confiança pública en les tecnologies d’IA.

- Transparència:

- Exigeix documentació clara de com els sistemes d’IA prenen decisions.

- Millora la responsabilitat, facilitant la identificació de biaixos o errors en els models d’IA.

Tots dos principis juguen un paper crucial en fomentar la confiança pública i en el desenvolupament responsable de la IA a nivell global i ja és bona noticia que aquests principis siguin essencials i imprescindibles.

Reptes en l’harmonització d’estàndards d’ètica de la IA a nivell global

I quins són els obstacles, els reptes que ens trobem? Analitzem-los:

Divergència reguladora i reptes de compliment

Com ja em dit. un dels principals obstacles per a l’alineació dels estàndards d’ètica de la IA entre la UE i els països no comunitaris és la divergència reguladora. La Llei d’IA de la UE, amb el seu enfocament basat en el risc, és bastant diferent dels marcs més voluntaris de països com els EUA. Aquesta incoherència crea desafiaments significatius de compliment per a les empreses que operen a nivell internacional.

Problemes geopolítics i relacions internacionals

Naturalment, les tensions geopolítiques també afecten els esforços per alinear els estàndards d’ètica de la IA a nivell mundial. Les grans potències com la UE, els Estats Units i la Xina sovint tenen interessos en conflicte que dificulten el progrés col·laboratiu. Aquests dinàmiques geopolítiques compliquen l’establiment d’un marc global unificat per a l’ètica de la IA.

Diversitat cultural i consideracions ètiques

Les diverses perspectives culturals sobre l’ètica afegeixen una altra capa de complexitat als esforços d’harmonització globalja que estan profundament influenciades per les normes i els valors culturals, que varien considerablement d’una regió a una altra. El que es considera ètic en una cultura potser que no tingui tanta importancia per motius culturals o politics en una altre banda del món.

Però encara hi ha un bri d’esperança, gràcies a iniciatives com la Recomendació sobre l’Ètica de la IA de la UNESCO , que ofereixen una via important per a l’alineació global en matèria d’ètica. Aquesta recomendació proporciona principis fonamentals que poden servir com a base per als països que volen desenvolupar els seus propis marcs ètics, ja que els seus els principis clau inclouen els drets humans ( garantir que la IA els respecti i els promogui , la inclusivitat (fomentar la participació diversa en el desenvolupament de la IA) i la sostenibilitat ambiental (promoure solucions d’IA sostenibles i respectuoses amb el medi ambient).

A més, hi han en marxa iniciatives multilaterals com el Partenariat Global sobre IA (GPAI), on s’estan creant plataformes per al diàleg i la cooperació internacional, que poden ajudar a superar els reptes ètics que sovint transcendeixen les fronteres nacionals.

Conclusió

El futur dels estàndards d’ètica de la IA depèn de la cooperació global. Harmonitzar aquests estàndards és essencial per garantir que la IA es desenvolupi de manera responsable i serveixi als interessos de la humanitat. Iniciatives com la UNESCO i col·laboracions internacionals poden ajudar a crear un marc global cohesionat que asseguri que la IA sigui transparent, fiable i respectuosa amb els drets humans a nivell mundial, però crec que el camí (com altres que ja s’han recorregut) serà llarg i tortuos… a veure com ens en sortim.